¿Dónde se tomó esa foto? Las computadoras alguna vez estuvieron en desventaja para los humanos en su capacidad de usar el contexto y la memoria para deducir la ubicación de una imagen. Pero esos días pueden estar llegando a su fin. Como informa Julie Morgenstern para MIT Technology Review, una nueva red neuronal desarrollada por Google puede superar a los humanos casi siempre, incluso con fotos tomadas en interiores.

contenido relacionado

- ¿Cuántos escritores de comedia se necesitan para ayudar a AI a contar una broma más divertida?

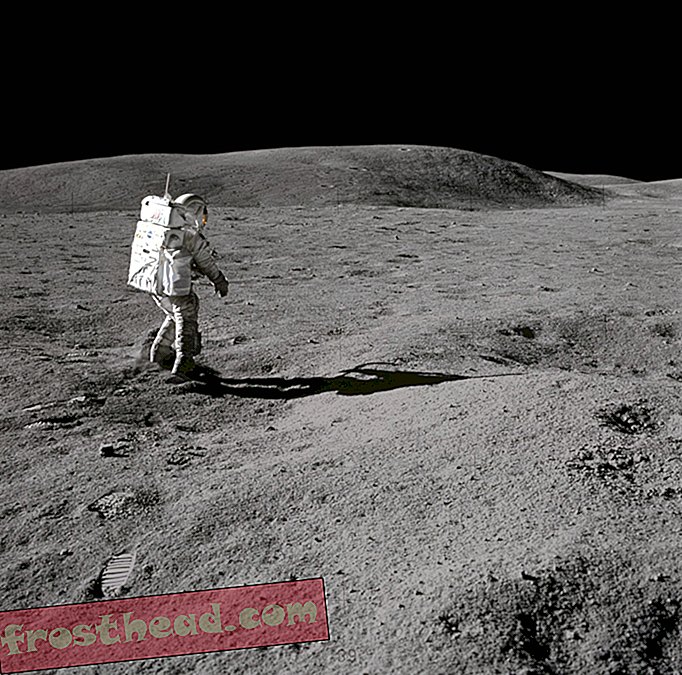

Se llama PlaNet y utiliza los píxeles de una foto para determinar dónde se tomó. Para entrenar la red neuronal, los investigadores dividieron la Tierra en miles de "células" geográficas, luego ingresaron más de 100 millones de imágenes geoetiquetadas en la red. Algunas de las imágenes se usaron para enseñar a la red a descubrir dónde cayó una imagen en la cuadrícula de celdas, y otras se usaron para validar las imágenes iniciales.

Luego las cosas se pusieron serias: los investigadores colocaron otros 2.3 millones de imágenes con etiquetas y pusieron a prueba la red. PlaNet descubrió dónde se tomó el 3.6 por ciento con "precisión a nivel de calle", otro 10.1 por ciento a nivel de ciudad, 28.4 por ciento a nivel de país y 48 por ciento a nivel de continente. Aunque no es perfecto, eso es bastante bueno para una computadora.

Finalmente, los investigadores ponen a prueba su red. Se enfrentaron a las personas para ver qué tan bien se compara con sus mejores intentos de adivinar una ubicación. El 56 por ciento de las veces, PlaNet adivinó mejor que los humanos, y sus suposiciones erróneas fueron solo una mediana de aproximadamente 702 millas de distancia de la ubicación real de las imágenes. En contraste, las suposiciones erróneas de los sujetos humanos estaban a más de 1, 400 millas de distancia.

Si todo esto te recuerda el malvado sistema Skynet de The Terminator, que fue diseñado para localizar hardware militar antes de que se volviera sensible y destruyera a toda la humanidad, no estás solo. La comparación ya se ha hecho, y dadas las habilidades sobrehumanas de las redes, es bastante adecuada. Bueno, excepto por la parte sensible y malvada.

Los investigadores piensan que un día, las redes neuronales se incorporarán a cosas como los teléfonos celulares para realizar análisis cada vez más complejos e incluso enseñarse mutuamente. Pero en estos días, los sistemas de autoorganización parecen contentos con averiguar dónde se toman las fotos y crear arte trippy y digno de galería ... por ahora.