![]()

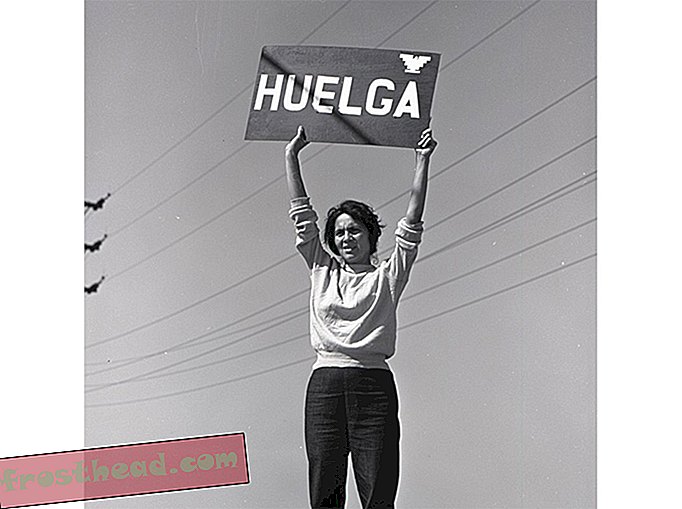

Análisis facial en el trabajo. Imagen cortesía de Affectiva.

Tanto tiempo como pasamos con nuestros teléfonos celulares, computadoras portátiles y tabletas, sigue siendo una relación unidireccional. Actuamos, ellos responden. Claro, puedes mantener una conversación con Siri en tu iPhone, y aunque es rápida, difícilmente califica como bromas juguetonas. Haces preguntas, ella da respuestas.

Pero, ¿qué pasaría si estos dispositivos realmente pudieran leer nuestras emociones? ¿Qué pasaría si pudieran interpretar cada pequeño gesto, cada señal facial para que puedan evaluar nuestros sentimientos, así como, quizás mejor que, nuestros mejores amigos? Y luego responden, no con información, sino con lo que podría pasar por empatía.

Todavía no estamos allí, pero nos estamos moviendo rápidamente en esa dirección, impulsados por un campo de la ciencia conocido como computación afectiva. Se basa en un software que puede medir, interpretar y reaccionar ante los sentimientos humanos. Esto podría implicar capturar su cara en la cámara y luego aplicar algoritmos a cada aspecto de sus expresiones para tratar de dar sentido a cada sonrisa y frotamiento de la barbilla. O puede implicar leer su nivel de molestia o placer al rastrear qué tan rápido o con cuánta fuerza toca un texto o si usa emoticones. Y si parece demasiado agitado, o borracho, puede recibir un mensaje que sugiere que es posible que desee dejar de presionar el icono de envío.

Al ver lo difícil que es para nosotros los humanos entender a otros humanos, esta noción de máquinas de programación para leer nuestros sentimientos no es un pequeño desafío. Pero está acelerando, a medida que los científicos enfocan su atención en los dispositivos de enseñanza de la inteligencia emocional.

Cada movimiento que haces

Uno de los mejores ejemplos de cómo puede funcionar la computación afectiva es el enfoque de una compañía llamada, apropiadamente, Affectiva. Registra expresiones y luego, utilizando algoritmos patentados, examina las señales faciales, aprovechando una base de datos de casi 300 millones de cuadros de elementos de rostros humanos. El software ha sido refinado hasta el punto en que puede asociar varias combinaciones de esos elementos con diferentes emociones.

Cuando fue desarrollado en el Laboratorio de Medios del MIT por dos científicos, Rosalind Picard y Rana el Kaliouby, el software, conocido como Affdex, fue diseñado con el propósito de ayudar a los niños autistas a comunicarse mejor. Pero claramente tenía un gran potencial en el mundo de los negocios, por lo que MIT dividió el proyecto en una empresa privada. Desde entonces ha recaudado $ 21 millones de los inversores.

Entonces, ¿cómo se usa Affdex? En la mayoría de los casos, se trata de observar a la gente mirando comerciales. registra a las personas cuando ven anuncios en sus computadoras (no se preocupe, debe optar por esto) y luego, en base a su base de datos de señales faciales, evalúa cómo se sienten los espectadores sobre lo que han visto. Y el software no proporciona solo un veredicto general positivo o negativo; desglosa las reacciones de los espectadores segundo a segundo, lo que permite a los anunciantes identificar, con más precisión que nunca, qué funciona en un comercial y qué no.

También puede ver que mientras las personas dicen una cosa, sus caras pueden decir otra. Durante una entrevista con el Huffington Post, el Kaliouby dio el ejemplo de la respuesta a un anuncio de loción corporal que se emitió en la India. Durante el comercial, un esposo toca juguetonamente el estómago expuesto de su esposa. Luego, varias mujeres que lo habían visto dijeron que encontraron esa escena ofensiva. Pero, según el Kaliouby, los videos de los televidentes mostraron que cada una de las mujeres respondió a la escena con lo que ella llamó una "sonrisa de placer".

Ella ve oportunidades más allá del mundo de la publicidad. Los televisores inteligentes podrían ser mucho más inteligentes sobre qué tipo de programas nos gustan si son capaces de desarrollar un banco de memoria de nuestras expresiones faciales. Y los políticos podrían obtener reacciones en tiempo real a cada línea que pronuncian durante un debate y adaptar sus mensajes sobre la marcha. Además, dice el Kaliouby, podría haber aplicaciones de salud. Ella dice que es posible leer el ritmo cardíaco de una persona con una cámara web analizando el flujo de sangre en su rostro.

"Imagínese tener una cámara encendida todo el tiempo monitoreando su ritmo cardíaco", le dijo al Huffington Post, "para que pueda decirle si algo está mal, si necesita ponerse en forma o si está frunciendo el ceño todo el tiempo". tiempo y necesidad de relajarse ".

Entonces, ¿qué te parece espeluznante o genial?

Dispositivos de seguimiento

Aquí hay otras cinco formas en que las máquinas reaccionan a las emociones humanas:

- ¿Y cómo estuvo mi día ?: Investigadores de la Universidad de Cambridge han desarrollado una aplicación móvil de Android que monitorea el comportamiento de una persona durante todo el día, usando llamadas entrantes y mensajes de texto, además de publicaciones en redes sociales para controlar su estado de ánimo. La aplicación, llamada "Sentimiento de la emoción", está diseñada para crear un "viaje de descubrimiento", que permite a los usuarios tener un registro digital de los picos y valles de sus vidas cotidianas. Los datos pueden almacenarse y usarse para sesiones de terapia.

- Y este soy yo después de la tercera taza de café: luego está Xpression, otra aplicación de seguimiento del estado de ánimo creada por una compañía británica llamada EI Technologies. En lugar de depender de las personas en terapia para mantener diarios de sus cambios de humor, la aplicación escucha los cambios en la voz de una persona para determinar si están en uno de los cinco estados emocionales: calma, feliz, triste, enojado o ansioso / asustado. Luego mantiene una lista de los estados de ánimo de una persona y cuándo cambian. Y, si la persona lo desea, este registro puede enviarse automáticamente a un terapeuta al final de cada día.

- ¿Qué pasa si simplemente odias escribir en un teléfono? : Los científicos de Samsung están trabajando en un software que evaluará su estado de ánimo por la forma en que escribe sus tweets en su teléfono inteligente. Al analizar qué tan rápido escribe, cuánto tiembla el teléfono, con qué frecuencia retrocede los errores y cuántos emoticones usa, el teléfono debería poder determinar si está enojado, sorprendido, feliz, triste, temeroso o disgustado. Y en función de la conclusión que extraiga, podría incluir con su tweet el emoticón apropiado para informar a sus seguidores sobre su estado mental.

- Simplemente no invite a sus amigos a mirar: usando un sensor usado en la muñeca y una cámara de teléfono inteligente alrededor del cuello, los investigadores del MIT han creado un sistema de "registro de vida" que recopila imágenes y datos diseñados para mostrar a una persona qué eventos representaron sus altibajos emocionales. El sistema, llamado Inside-Out, incluye un bio-sensor en una pulsera que rastrea emociones intensas a través de cargas eléctricas en la piel mientras el teléfono inteligente rastrea la ubicación de la persona y toma varias fotos por minuto. Luego, al final del día, el usuario puede ver sus experiencias, junto con todos los datos del sensor.

- Tu frente dice que tienes problemas: esto probablemente fue inevitable. Investigadores de la Universidad del Sur de California han creado un terapeuta robótico que no solo está programado para alentar a los pacientes con “Uh-huhs” oportuno, sino que también es experto, utilizando sensores de movimiento y análisis de voz, para interpretar cada gesto y voz de un paciente. inflexión durante una sesión de terapia.

Bono de video: ¿Quiere ver cuán extraña puede ser esta tendencia de dispositivos que leen las emociones humanas? Echa un vistazo a esta promoción de Tailly, una cola mecánica que aumenta tu nivel de emoción mediante el seguimiento de tu frecuencia cardíaca y luego se mueve adecuadamente.

Más de Smithsonian.com

Este nuevo robot tiene un sentido del tacto

Cocinar con robots